La ciència-ficció ha contribuït a crear debat i consciència crítica sobre la tecnologia i la Intel·ligència Artificial

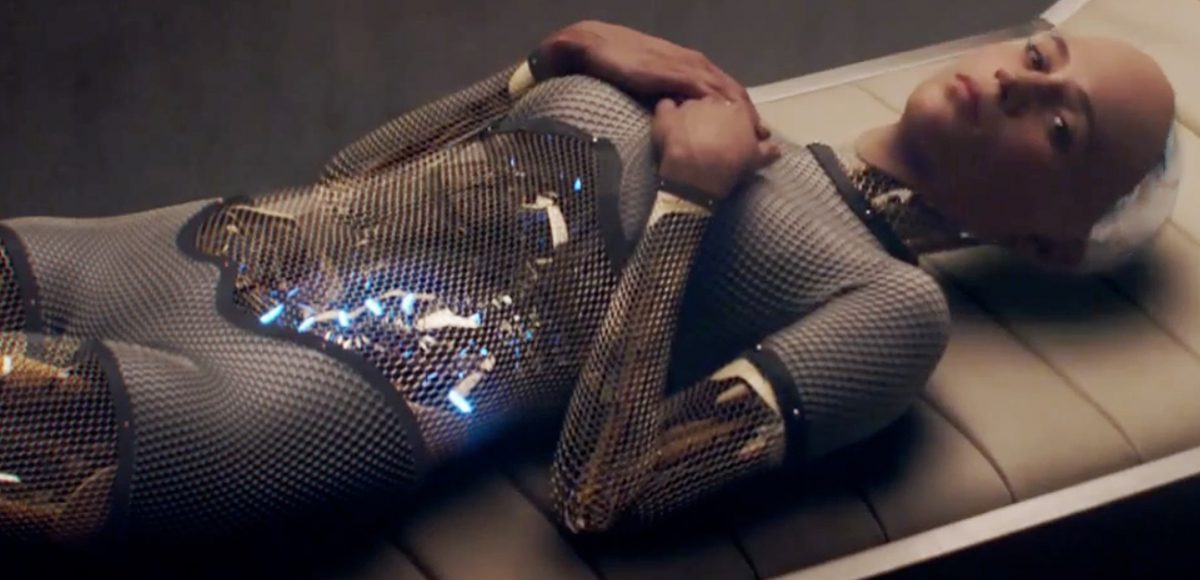

“Maleït creador! Per què no vaig perdre en aquell moment la flama de l’existència que tan imprudentment vares encendre?” brama, amb set de venjança, la solitària criatura de Víctor Frankenstein a l’obra mestra de Mary Shelley. Sense màquines al relat, Frankenstein ha contribuït a crear un imaginari simbòlic de la Intel·ligència Artificial (IA) més a prop del recel que de l’encís: les nostres creacions poden rebel·lar-se i posar la humanitat contra les cordes. Són un mirall d’aquesta por irracional les novel·les 1984, Jo, robot, Un Món feliç; les pel·lícules Blade Runner, Matrix, Ex-Machina; les sèries Black Mirror, Westworld… La llista és inacabable.

Segons l’estudi El Factor Frankenstein: anatomia de la por a la Intel·ligència Artificial, elaborat per SogetiLabs el 2017, més d’un terç dels ciutadans de la Unió Europea creu que l’IA serà una amenaça per a la supervivència de l’home a llarg termini. Mentrestant, un 46% no veu cap benefici en la idea de desenvolupar robots humanoides. “Hi ha quelcom d’atàvic en la por que els humans sentim cap al progrés i la tecnologia. Cap a un futur que ens parla de suplantació”, escriu el director de la pel·lícula Eva, el barceloní Kike Maíllo, a La Màquina Aparentment Desobedient, publicat a la Revista Idees del Centre d’Estudis de Temes Contemporanis (CETC), que dimecres va oferir un diàleg en línia sobre l’imaginari simbòlic de l’IA entre dos investigadors de primer nivell: Ramon López de Mántaras i Carme Torras.

El cert és que la ciència-ficció ha apel·lat molt més a la distopia que a la utopia. I quan la tecnologia entra en escena, ja podem presagiar un final apocalíptic. Tot i això, la ciència-ficció no només ha servit per sembrar el terror: també ha contribuït a “crear debat i consciència crítica sobre la tecnologia i la Intel·ligència Artificial”, va advertir Carme Torras.

De fet, Torras, que és investigadora a l’Institut de Robòtica i Informàtica Industrial de la Universitat Politècnica de Catalunya (UPC), doctora en Informàtica i novel·lista, ho ha posat en pràctica a La mutació sentimental (Editorial Pagès Editors), on es planteja si el fet de ser criat per mainaderes artificials i educat per mestres robòtics afectaria els nostres hàbits intel·lectuals, emocionals i socials. Al mateix temps, posa sobre la taula una sèrie de qüestions que són utilitzades actualment a diverses universitats del món per impartir formació ètica en algunes carreres tecnològiques. Així, Orwell, Huxley o Shelley han entrat a l’acadèmia per polemitzar el dilema seguretat versus llibertat, el totalitarisme tecnològic, els substituts emocionals, les rèpliques humanes i un prolongat etcètera. Els interrogants morals també perseguiran el lector d’Enxarxats, obra de la mateixa autora –i a la qual la Fundació Bit va dedicar aquesta ressenya. Aquesta setmana, la Fundació Mallorca Literària ha entrevistat a Torras sobre aquesta novel·la i ha reflexionat amb ella sobre els múltiples dilemes que plantegen les xarxes socials a la societat.

La màquina es rebel·la

Predir el futur mai ha estat fàcil. Tot i això, durant l’acte del CETC, Ramón López de Mántaras, enginyer físic i investigador del Consell Superior d’Investigacions Científiques (CSIC), ens recordà la gran quantitat de projectes de recerca en IA dels darrers 50 anys que van ser anticipats per 2001: una Odissea a l’Espai (1968). Per exemple, el reconeixement facial -“fins i tot quan la cara només hi està dibuixada”, precisa l’investigador-, el diagnòstic predictiu d’avaries, la lectura de llavis, la capacitat de jugar a escacs a molt alt nivell o el domini absolut del llenguatge natural. López de Mántaras afegeix que el supercomputador Hal, encarregat de controlar les funcions de la nau espacial, no simula tenir estats mentals sinó que realment els experimenta, així com la por de ser desconnectat. Per això Hal “mata en defensa pròpia”, diu. De nou, la màquina es rebel·la.

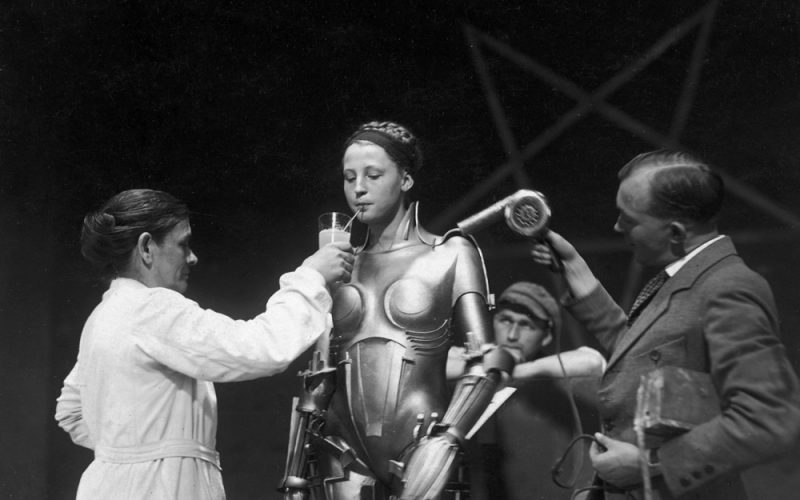

No obstant això, el dilema del robot entre acatar i sotmetre’s va aparèixer per primer cop a l’obra d’Isaac Asimov. El visionari autor, que enguany hauria complit 100 anys, despuntà com a escriptor enmig de l’horror d’Hiroshima i Nagasaki i una allau d’avenços tecnològics que amenaçaren com mai abans la humanitat. Asimov, científic de professió, va recórrer a la literatura per plantejar els dubtes i les pors que li generava la ciència: al seu llibre Jo, Robot va establir les famoses lleis fonamentals de la convivència entre humans i robots, que han estat assimilades per la comunitat que investiga en IA.

La fragmentació del coneixement en compartiments estancs mai no ha afavorit el progrés. Per això, la multidisciplinarietat és necessària si volem evitar el desastre. Com escriu Torras a la Revista Idees, el món de la recerca de la IA ha vist “la necessitat de treballar conjuntament amb científics socials, psicòlegs, advocats, filòsofs i antropòlegs per tal d’analitzar les implicacions socials i ètiques de les tecnologies que s’estan desenvolupant i la forma com s’estan desplegant”. I en aquesta tasca, la literatura, el setè art i els diferents engranatges que alimenten el nostre imaginari simbòlic hi tenen molt a dir. Com va dir Neal Stephenson, la ciència-ficció pot donar idees per a innovacions tècniques i, sobretot, “pot oferir una imatge coherent d’aquestes innovacions integrades en una societat, en l’economia i en la vida de les persones”.

Així, Kike Maíllo aconsegueix a la seva pel·lícula Eva que el gran públic es plantegi: Les màquines de companyia podran ser bones amigues nostres? Serem capaços d’establir lligams d’afecte amb artefactes que es limiten a obeir el seu propietari? I si els conferim consciència i lliure albir per a igualar-nos-hi, quina relació de poder hi establirem amb les màquines, una vegada hagin adquirit una intel·ligència immensament superior a la nostra?

One Reply to “Distopies tecnològiques per jutjar el demà”

Els comentaris estan deshabilitats.